Недостаточно создать и наполнить сайт, необходимо еще обеспечить условия, при которых его страницы попадут в органическую выдачу поисковых систем. Поговорим о том, по каким причинам сайта нет в поиске чаще всего и что с этим делать?

Проверка индексации сайта через Яндекс Вебмастер и Google Search Console

Для того, чтобы проверить качество индексации страниц сайта, достаточно воспользоваться сервисами от двух поисковиков: Яндекс Вебмастер и Google Search Console. Каждая из этих панелей показывает количество находящихся в индексе страниц для своего поисковика (Яндекс и Google, соответственно).

Google Search Console

Зайдя в этот инструмент, на главной странице находим блок «Покрытие». В нем показывается график с количеством страниц сайта в индексе Гугла (зеленый график), и количество страниц, которые содержат ошибки (красный график). В таком виде удобно смотреть как добавлялись/удалялись страницы из индекса в определенный отрезок времени.

Из блока «Покрытие» есть возможность перехода в полный отчет. На отдельной странице будет показан график, количество ошибок, загруженных страниц без ошибок и исключенные страницы. Кликая по каждому из показателей, получаем графические данные по нему, а также списки самих URL-адресов.

Заходим в блок «Покрытие»

Просматриваем нужный отчет

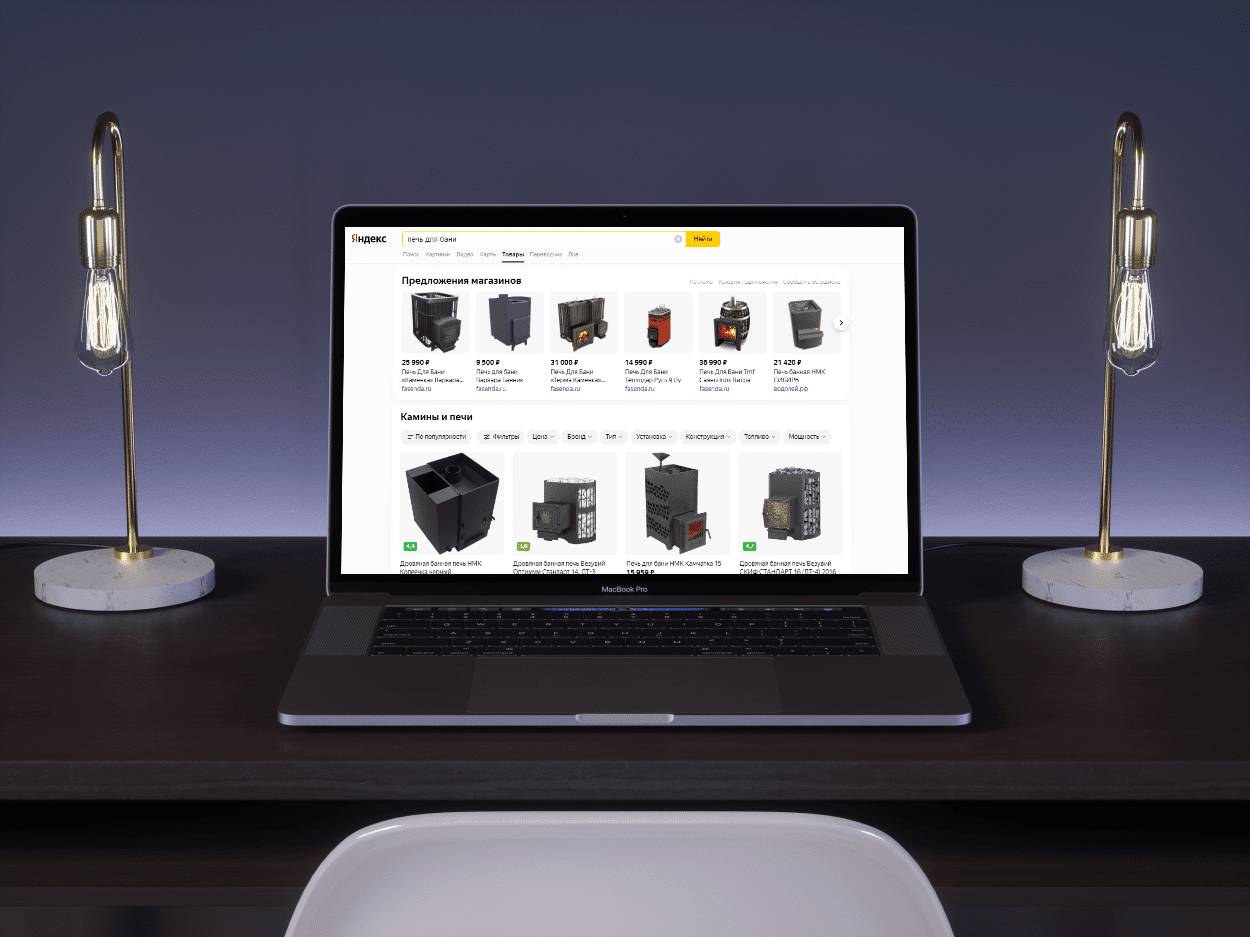

Яндекс Вебмастер

Аналогичные возможность есть у Яндекс Вебмастера. Чтобы посмотреть проиндексированные страницы Яндексом, заходим в пункт «Индексирование – Страницы в поиске». Пролистав ниже, находим все страницы сайта, которые на текущий момент находятся в индексе.

Выбираем раздел «Индексирование – Страницы в поиске»

Список проиндексированных страниц

Инструмент позволяет просматривать исторические данные о том, как менялось количество проиндексированных страниц. Для этого вверху графика нажимаем «История», а внизу слева выставляем необходимый временной диапазон.

Анализируем историю индексации

Как видно из примера, сайт выпадал из индекса полностью, но через какое-то время вернулся вновь.

Почему сайт может выпасть из индекса? Причины и их решения

Причин, по которым сайта нет в поиске, может быть множество, рассмотрим основные.

Новый сайт или страница

Процесс индексации представляет собой сканирование поисковым краулером документов сайта. После чего данные обрабатываются, а уже после появляются (или не появляются) в поисковой выдаче. Обновление поисковой базы называется Update, и у каждого поисковика он происходит с разной скоростью. Поэтому если страницы недавно созданного сайта не отображаются в поиске, то чаще всего они еще просто не были проиндексированы.

Отсутствие запрета на индексацию сайта

Закрыть от индексации можно весь сайт, либо отдельные его документы. Поэтому вторым шагом по поиску причины отсутствия сайта в индексе, будет проверка файла robots.txt, находящегося в корне файловой системы.

Данный файл открывается с помощью любого текстового редактора, в нем должны отсутствовать следующие строки:

Блок на весь сайт User -agent: * Disallow: / Или для отдельных страниц: User-agent: * Disallow: /page.html

Страницы могут быть закрыты от индексации посредством метатегов. Если известно, каких именно нет страниц в индексе, проверьте их вручную (либо с помощью автоматизированных инструментов, например, Screaming Frog SEO Spider) на наличие следующего метатега (он доступен только для Яндекса, Google его игнорирует):

<meta name="robots" content="noindex" />

Кроме этого, любой документ можно проверить на доступность поисковыми роботами в инструменте Яндекс Вебмастера: Индексирование – Анализ robots.txt. Вставляем в блоке «Разрешены ли URL?» адрес страницы и смотрим результат.

Проверяем отдельные URL на индексацию

Дублированный контент

Поисковые системы заинтересованы в том, чтобы их выдача была как можно более качественной, максимально отвечающей запросам пользователей. Нет смысла добавлять в поиск страницы, если их дубли уже есть в интернете.

Поэтому перед публикацией контента, особенно текстового, обязательно проверяйте его на уникальность, это можно сделать в следующих сервисах:

- Text.ru.

- Etxt.ru.

- Advego.ru.

Уникальность не должна быть ниже 75%, но для технических или юридических текстов этот порог может быть ниже в силу специфики контента.

Если сайт наполняется текстами на основе рерайтинга, то обращайте внимание на его качество. На сегодняшний день поисковики хорошо «понимают» структуру текстов, грамматику и прочие его характеристики. Поэтому, если рерайт был поверхностным с простой заменой слов на синонимы и т.д., то, вероятнее всего, это обнаружится при индексации.

Запрет в .htaccess

Через служебный файл .htaccess сайт также можно закрыть от индексации, поэтому проверяем его на отсутствие подобных строк:

SetEnvIfNoCase User-Agent "^Googlebot" search_bot

Запрет в самой CMS

WordPress — проверка запрета индексации

Отсутствие четкой структуры сайта

Весь контент на сайте должен находиться в структурированном виде, на различных уровнях вложенности (Главная – Категория – Подкатегория – и т.д.). Причем не рекомендуется создавать уровни вложенности более 5. Если эти два правила не соблюдаются, то процесс индексации может затянуться по времени, особенно, если страниц на сайте много.

Страница или сайт недоступны

Сайт и его страницы должны быть доступны как посетителям, так и поисковым краулерам, и отдавать код 200. По разным причинам, этот код может отличаться:

- 4xx – документ недоступен по текущему адресу. Не рекомендуется удалять страницы, находящиеся в индексе поисковика, т.к. это может негативно сказать на ранжировании сайта. Лучше сделать 301-редирект (перенаправление) с удаленной страницы на другую релевантную.

- 5xx – сервер не в состоянии выполнить запрос.

Чтобы проверить код ответа сервера, заходим в одноименный инструмент в Яндекс Вебмастере.

Инструмент для просмотра кода ответов сервера

Пример отчета

На сайт наложены фильтры

Если сайт или его страницы резко выпали из индекса, скорее всего, был наложен фильтр со стороны поисковой системы. Проверить на наличие некоторых фильтров можно в панелях вебмастеров.

В Google Search Console заходим в пункт «Меры, принятые вручную». Если на сайт применена какая-либо санкция со стороны сотрудников Google, то эта информация будет доступна здесь.

Google Search Console

Автоматически наложенные санкции не отображаются в панели, но их можно обнаружить по косвенным признакам.

Проблемы с Яндексом также частично отображаются в Вебмастере на странице «Сводка».

Проблемы сайта в Яндекс.Вебмастере

Вот список некоторых действий, которые могут привести к санкциям со стороны поисковиков:

- Неадекватное наращивание внешней ссылочной массы. Поисковики не любят манипулирование факторами ранжирования, поэтому при обнаружении накладывают фильтры, понижая сайт в результатах выдачи, либо вовсе удаляют его (или отдельно взятые страницы) из индекса. Фильтры: Минусинск и Пингвин.

- Низкокачественный или неуникальный контент. Фильтры: АГС, Panda, Баден-Баден.

- Переоптимизация контента. Недопустимо превышать порог 3-5% плотности ключевых слов, а также использовать вхождения в неестественном виде (например, «купить квартира Москва»).

- Накрутка поведенческих факторов, например, фейковые посещения сайта.

Сайт заблокирован государственными органами

В РФ действует закон, запрещающий распространение определенного типа контента в интернете. За это (кроме уголовного преследования), возможна блокировка сайта по решению ряда государственных органов: Роскомнадзора, Ген. Прокуратуры, МВД, Роспотребнадзора и т.д.

Эта причина блокировки одна из самых явных, т.к. при посещении сайта пользователь получает всю информацию со ссылками на федеральный закон.

Блокировка сайта

Небольшой список материалов, которые подлежат такой блокировке:

- Информация о способах изготовления и т.д. наркотических веществ.

- Антиправительственная информация, по типу организации митингов, призывы к массовым беспорядкам и т.д.

- Описание способов совершения самоубийств.

- И прочее.

Дублированный контент внутри сайта

Если на сайте появляются страницы-дубли, то часть из них выпадет из индекса. Причем может случиться так, что выпадет именно целевая страница.

Дубли чаще всего появляются в силу специфики работы CMS, когда одна и та же страница доступна по разным адресам, но для поисковика это разные документы. Чтобы этого избежать, рекомендуется изучить подобные нюансы используемой CMS и настроить ее таким образом, чтобы дубли не появлялись (например, установив плагин), либо с них было перенаправление (301-редирект) на основную страницу.

В рамках данной статьи мы рассмотрели основные причины, по которым сайт может выпасть из поиска. Определив и решив их, после одного или нескольких Update поисковой базы, страницы сайта вернутся в органическую выдачу.