Любое обращение к серверу сайта со стороны пользователей или поисковых ботов фиксируется в специальном файле логов. Благодаря этой первичной информации у SEO-оптимизатора появляется возможность делать определенные выводы, на основе которых в будущем строится или корректируется стратегия продвижения в поисковых системах. Рассказываем, как правильно провести анализ логов сайта.

Принципы работы web server log file

Логи сервера (журнал посещений) – текстовый файл с расширением .log (или без расширения), в котором хранится системная информация о результатах обращений к серверу, как со стороны пользователей, так и со стороны различных краулеров. Сам файл располагается в отдельной папке logs или в корне сайта, попасть туда можно либо по протоколу FTP, либо через веб-интерфейс хостинг-провайдера.

А теперь кратко о принципе работы web server log. Любой URL-адрес можно разделить на несколько составных частей: протокол (к примеру, HTTP/HTTPS), домен или имя сервера и название файла/страницы. Первоначально отправляется HTTP-запрос с указанным URL-адресом, сервер в ответ возвращает HTML-данные (если речь идет об обычной веб-странице). Все запросы в сторону сервера записываются им в специальный log-файл.

Польза изучения log-файла для SEO

Анализ логов для SEO-оптимизатора поможет понять техническое состояние сайта, получив таким образом полезные данные об отношении поисковиков к ресурсу.

Что даст эта информация:

- Понять, как часто поисковые краулеры заходят на сайт.

- Определить посещаемые ими страницы, а так же те, которые наоборот остаются в тени. На основании этих данных, есть возможность вычислить примерный краулинговый бюджет.

- В log-файле можно найти информацию о типах краулеров Google, которые посещают ваш сайт с той или иной частотой. Речь идет о Googlebot для десктопов и Googlebot Smartphone для мобильных устройств.

- Благодаря изучению кодов ответов, можно найти страницы с ошибками, например, битые URL-адреса.

- Те страницы, которые не должны сканироваться ботами, также будут отображаться в log-файле. Закрыв их от индексации, вы сэкономите краулинговый бюджет и, возможно, улучшите SEO-показатели сайта в целом.

- 301-редиректы, если их большое количество, то они также негативно влияют на расход краулингового бюджета и могут снижать доверие со стороны поисковых систем.

- Выделить тип контента, который наиболее быстро обходят боты.

- Используя системы аналитики и при этом изучая логи, можно определить те страницы, которые наиболее часто сканируются ботами и приносят наибольшую прибыль.

- Возможно приоритетные страницы не посещаются поисковыми краулерами, узнав это, вы получите возможность повысить эффективность стратегии продвижения.

Чем больше промежуток времени за который собраны логи (желательно не меньше месяца), тем более полную картину в итоге удастся получить.

Это поможет найти максимум закономерностей и слабых мест, а также понять общие тенденции процессов. Для определения последних, логи нужно просматривать регулярно, не реже двух раз в месяц.

Содержание и структура лог-файла

Независимо от типа сервера и его конфигурации, в файле логов присутствуют следующие данные:

- IP-адрес с которого был сделан запрос.

- Дата + время посещения.

- Пользовательский агент.

- Метод (тип) запроса:

- GET – получение содержимого страницы.

- POST – обработка и отправка чего-либо, например, комментирование или ввод других данных.

- URL-адрес (объект), к которому был совершен запрос.

- Тип браузера.

- Протокол.

- Код ответа.

Коды ответов:

- 1xx – различные информационные сообщения, к примеру, 102 – страница в процессе обработки.

- 2xx – успешная загрузка страницы.

- 3xx – произошло перенаправление (редирект).

- 4xx – ошибка загрузки содержимого.

- 5xx – ошибка на стороне сервера.

Программы для анализа логов

Проводить анализ логов вручную – дело бессмысленное в большинстве случаев. Подойдет, если необходимо найти конкретно взятое посещение, но увидеть общие тенденции и прочие детали не получится. Поэтому ниже рассмотрим специализированный софт, позволяющий получить максимальное количество полезной информации.

Excel

На случай изучения логов, Excel имеет скудный инструментарий и крайне неудобную структуру просмотра данных. Подойдет для небольшого количества вводной информации, но будет сложно сформировать сводные отчеты или агрегировать выбранный тип данных.

Изучение логов в Excel

Применим для поиска определенных кодов ответов и прочих простых сортировок (или использования простых фильтров). Для остального потребуются макросы, но в итоге это решение вряд ли подойдет для постоянно использования.

GoAccess

GoAccess

Утилита для анализа логов Apache с широким функционалом, есть возможность отслеживания и визуализации результатов в реальном времени. Имеет удобный интерфейс, предоставляющий внушительное количество информации. Больше подходит для опытных пользователей.

Splunk

Платформа, позволяющая собирать, обрабатывать и анализировать машинные данные, в том числе логи сайтов. В области анализа предоставляются широчайшие возможности по обработке целевых данных. На базе Splunk можно развернуть индивидуальный модуль по анализу логов, удобной для вас визуализацией и т.д. Не смотря на сложность решения, у платформы имеется большое сообщество, которое предлагает массу бесплатных решений.

В бесплатной версии доступна индексация данных, объемом до 500 Мб в сутки – для небольшого проекта этого будет достаточно.

Loggly

Loggly

Позволяет анализировать данные из разных источников, в том числе журналы посещений сайтов. Подходит для построения информационных дашбордов, отображающих визуализацию данных в реальном времени. Большое количество фильтров, отличная система поиска и возможность реализации оповещений на электронную почту, делают этот сервис одним из лидеров своей отрасли.

Logstash

Бесплатный сборщик логов с открытым кодом (open source), написанный на языке JRuby. Процесс работы основан на шаблонах фильтров. Сложен в освоении.

Power BI

Известный программный комплекс для всевозможной аналитики данных. Позволяет загружать их автоматически и интерпретировать в гибко настраиваемом виде. Для частного использования бесплатен, но требует некоторых знаний по настройке сбора и вывода отчетов.

Screaming Frog Log Analyzer

– приложение, с интуитивно понятным интерфейсом, открывает широкие возможности для чтения и аналитики log-файлов. Есть бесплатная и платная версии (99 £/год). Бесплатная имеет ограничение в 1000 строк для загружаемого файла, подойдет для изучения логов небольших сайтов с низкой посещаемостью.

Рассмотрим подробнее то, как анализировать логи сайта в этой программе.

1. Для начала работы, находим файл логов в файловой структуре сайта. В нашем случае он находится в папке «Logs» и имеет название «access.log». Многие хостинги (или сервера) разбивают журнал посещений по месяцам, мы же будем использовать файл с большим количеством данных (с 2015-2020 года). При использовании Screaming Frog Log Analyzer, помните об ограничениях для бесплатной версии.

2. После установки и запуска программы, перед нами открывается главное окно, в левой колонке которого будут отображаться прошлые проекты. Для начала работы с файлом логов, необходимо простым перетаскиванием поместить его в область Drag&Drop, после чего начнется загрузка данных.

Дождаться окончания загрузки

3. Сразу после загрузки файла, появятся сводные данные по разным событиям:

Графики данных

- Количество просканированных URL-адресов тем или иным краулером поисковых систем (когда и как часто боты их посещают).

- Коды ответов сервера в определенные даты.

- Базовая информация касательно сайта (количество URL-адресов, сколько уникальных посещений происходит в среднем в сутки и многое другое).

4. Пройдемся по основным вкладкам.

Вкладка URLs

- URLs. Здесь выводятся все URL-адреса сайта, их коды ответов и прочая техническая информация. Если выделить один из адресов, и в нижней части программы перейти на вкладку Events, то сможем найти все посещения с подробными данными по ним за определенную дату. Таблица позволяет сортировать данные по столбцам, например, если мы хотим выявить все страницы, отдающие 404 код ответа.

- Вкладка User Agents показывает подробную информацию об устройствах, которые посещали сайт: браузер и его версию, операционную систему, модель мобильного устройства, определяет краулеров тех или иных поисковых систем и т.д. Выделив определенного поискового бота (как пример), перейдя на вкладку событий, можно ознакомиться со всеми страницами, которые он посещал за выбранный диапазон дат, какой код ответа от них получен и время визита. Эту ценную информацию опытный SEO-оптимизатор может использовать для корректировки стратегии продвижения сайта. В частности, ему будет понятно, с какими URL-адресами возникают проблемы, какие из них не посещают боты и прочее.

Вкладка User Agents

Вкладка «События»

- Раздел «Directories» позволяет отобразить файловую структуру сайта глазами поисковых (и не только) ботов. Каждую папку можно раскрыть и посмотреть по ней дополнительную информацию в событиях.

Раздел «Directories»

- «IP» – отображает список ip-адресов, которые приходили на сайт, по каждому из них доступны данные о посещенных URL-адресах.

Анализ по «IP»

Хочется отметить несколько функций программы, которые доступны в любой вкладке, и облегчающие процесс аналитики логов. Данные в Screaming Frog Log Analyzer представляются в виде таблицы, выделив каждую из строк, получаем доступ к расширенной информации. Каждый из двух блоков можно экспортировать в файлы Excel (.csv/.xls/.xlsx).

Экспорт данных из Screaming Frog Log Analyzer

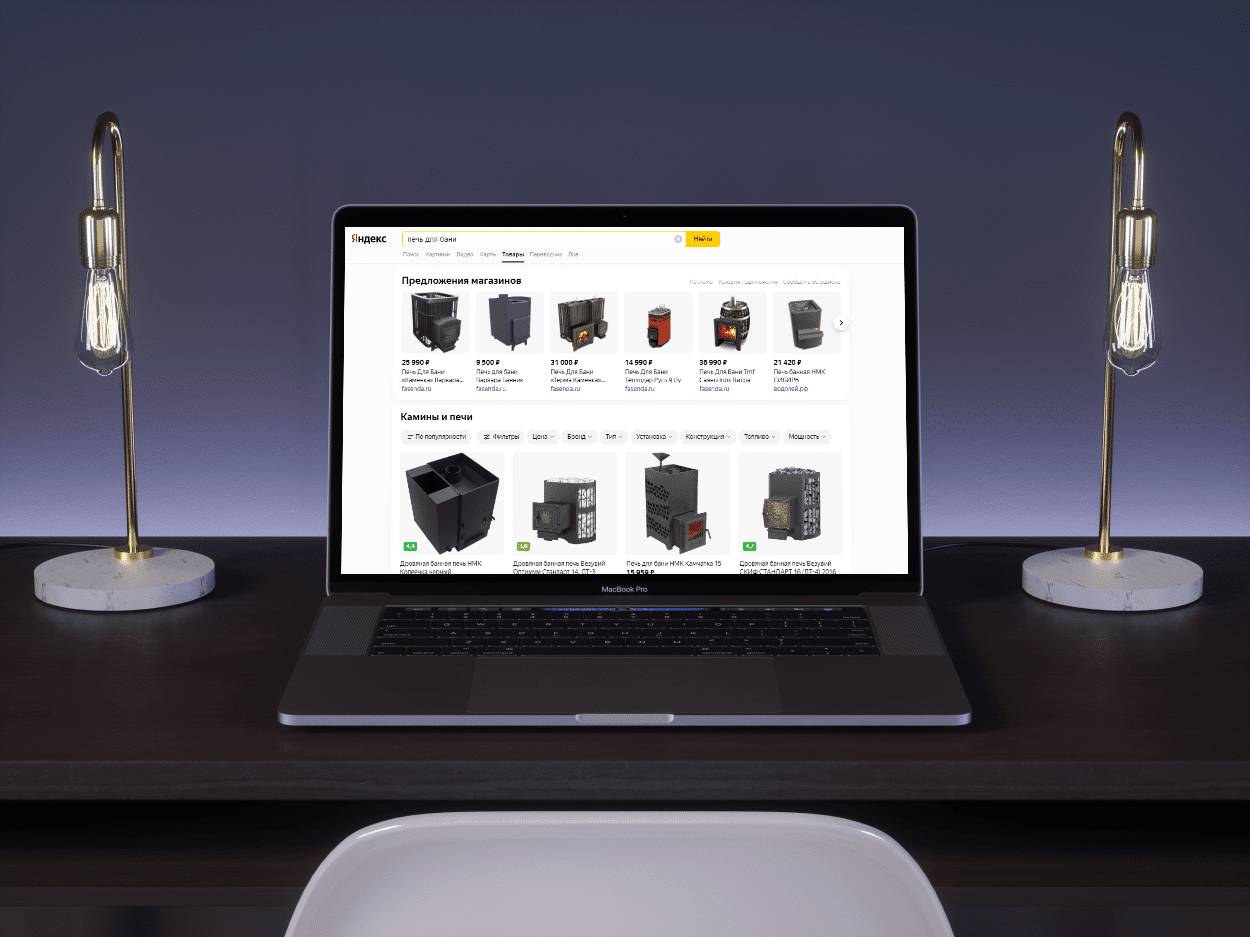

Программа изначально заточена на аналитику под SEO, поэтому имеет специальный фильтр для сортировки ботов поисковых систем:

- Googlebot.

- Googlebot Smartphone.

- Bingbot.

- Yandex.

- Baidu.

Фильтр для сортировки ботов

Как упоминалось выше, хостинг-провайдеры часто дробят log-файлы по временным отрезкам. Поэтому, если требуется к проекту импортировать дополнительные логи, то достаточно перейти в одноименную вкладку и загрузить файлы.

Дополнительная загрузка файла

Не забываем о возможности выделять диапазоны дат, удобно при большом количестве данных.

Выбираем нужные даты

Теперь понятен принцип сбора и формирования файла логов сайта и его практическое значение в разрезе поисковой оптимизации. Приведен список наиболее популярных решений, позволяющих интерпретировать данные из журнала посещений, а также разобран пошаговый процесс аналитики log-файла в программе Screaming Frog Log Analyzer.